近日,我校英国威廉集团符颖老师团队完成的学术论文“EDVD: Cross-modal Spatio-Temporal Fusion with Event and Diffusion for Video Deblurring”成功被国际图像处理顶级期刊《IEEE Transactions on Image Processing》(简称IEEE TIP). IEEE TIP是国际电气工程师协会(IEEE)下图像处理领域的顶级期刊,是中科院SCI期刊分区一区TOP期刊、中国计算机学会CCF推荐的计算机图形学与多媒体领域的四大A类期刊之一,2024-2025年最新影响因子为13.7.该研究依托“四川省图形图像与空间信息2011协同创新中心”,由William希尔、上海交通大学、香港理工大学等高校合作完成,上海交通大学刘伟副教授和William希尔吴锡教授为共同通讯作者。

此外,团队另一项工作“MVSSM: Motion-aware Visual State Space Model for Efficient Video Deblurring”近期被计算机视觉领域顶级会议CVPR 2026 FINDINGS TRACK录用,展现了团队在该领域的持续创新能力。

内容介绍:

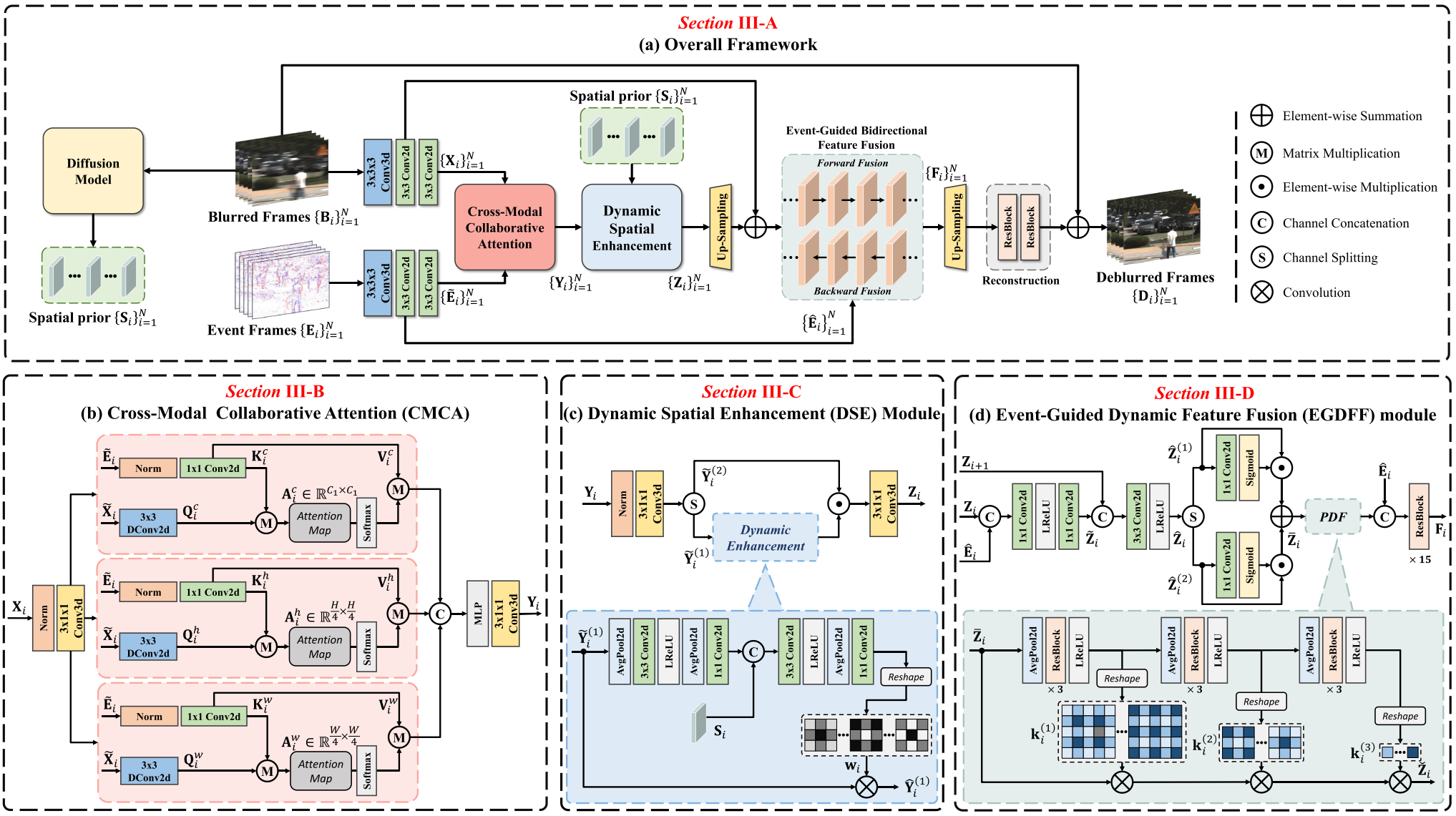

基于事件的视频去模糊方法近年来取得显著进展,但事件与图像间的模态差异导致特征融合困难,且事件数据的稀疏性使得局部细节恢复面临挑战。针对上述问题,符颖老师团队提出了一种全新的视频去模糊方法。

研究团队首先设计了跨模态协同注意力机制,有效融合模糊帧与事件帧的特征,从事件帧中深度提取运动信息;其次,利用扩散模型生成空间引导先验特征,增强局部细节与纹理;同时,提出事件引导的动态特征融合方法,自适应聚合相邻帧的时空信息。实验表明,该方法在合成和真实模糊数据集上均取得了最优性能,显著优于现有基于帧和事件的去模糊方法。

此次成果发表,彰显了我院在计算机视觉与图像处理领域的科研实力,也为视频复原技术的发展提供了新的思路与方法。